Commission Technique : compte rendu de la réunion du 11 février 2026

La réunion démarre à 17:00. Elle s’est déroulée en présence dans les locaux de la FICAM à Paris 16e, et simultanément en visioconférence, avec la participation de :

| Jean-Baptiste | BABIN | Backup Systems | CEO |

| Jérôme | BATTISTELLI | Armadas Studios | CEO |

| Béatrice | BAUWENS | MPC | Directrice Post&VFX Paris |

| Stéphane | BEDIN | FICAM | Délégéué Général Adjoint |

| Maxime | BEUCHER | NEOSET | Contenus PV 360 |

| Renaud | JUNGMANN | VFX Workshop | Fondateur |

| Adrien | LEDOUX | CINEKITA | Responsable commercial |

| Cécile | LIMAL | MOBILIS PRO | CEO |

| Hans-Nikolas | LOCHER | CST | Directeur du développement |

| Benoit | MAUJEAN | FICAM | Délégué Adjoint Technologies |

| Cécile | PECH GOURG | CN Films | Directrice générale |

| Jean-Christophe | PERNEY | ex CTM Group | Media & Entertainment Consultant |

| Mickael | ROUSSEAU | LUMEX | Directeur Technique |

| Benoit | RUIZ | PICS Studio | Directeur RSE et Data |

| Jérémie | TONDOWSKI | NEOSET | Président |

Ordre du jour

- Retour sur le PIDS 2026 par Benoit MAUJEAN (FICAM)

- Présentation du studio Neo.B4 par Jérémie TONDOWSKI (NEOSET)

1- Retours sur le PIDS 2026

par Benoit MAUJEAN (Ficam).

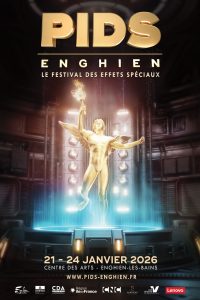

Le PIDS Enghien s’est tenu du 21 au 24 janvier 2026 au Centre des Arts d’Enghien-les-Bains, explorant la création numérique sous toutes ses formes : des effets visuels à la réalité virtuelle, en passant par l’animation et la 3D.

Voir le programme complet ici : https://www.pids-enghien.fr/wp-content/uploads/2026/01/PIDS2026-Programme-WEB.pdf

Liens vers les slides de la présentation.

Table ronde : les chiffres du secteur

Le mercredi 21 janvier, une table ronde animée par Yann Marchet, Délégué général de PIDS Enghien réunissait :

- Sophie Jardillier, Directrice adjointe des études, des statistiques et de la prospective – CNC

- Thomas Bohlay, Responsable des études – Audiens

- Stéphane Bedin, Délégué général adjoint – FICAM

- Olivier Emery, CEO de Trimaran et Co-Président de France VFX

pour présenter un panorama chiffré du secteur des VFX en France et en analyser les grandes tendances.

Les chiffres sont basés sur les remontées des chiffres déclarés au CNC – devis, agrément, Crédit d’Impôt International (chiffres 2024), complétés par les données d’Audiens pour les emplois plus en complément les données de l’Observatoire des Métiers et des Marchés de la Ficam, qui recense les tournages et la post-production des films de fiction unitaires et des séries télévisées, constatés et déclarés par ses adhérents (chiffres 2025).

On constate une tendance à la baisse dans les entreprises de VFX. Après 3 années de hausse, l’activité marque le pas en 2024 : les studios VFX enregistrent une baisse de -6 % des effectifs et -10 % de leur masse salariale. Une dynamique similaire est observée dans l’animation, confirmant un ralentissement global du secteur. Avec une chute marquée de l’intermittence : en 2024, le nombre d’intermittents recule de -8 %, contre -3 % pour les permanents. Chez les techniciens, la baisse est encore plus brutale : -18 %, soit près d’un emploi sur cinq en moins par rapport à 2023. Avec un recul qui touche presque exclusivement les profils les moins expérimentés.

On constate cependant un recours généralisé aux VFX dans les longs métrages de fiction d’initiative française, avec un niveau de dépenses record en 2024. La prorogation du Crédit d’Impôt International jusqu’à fin décembre 2028 devrait rassurer les donneurs d’ordre des studios US et relancer l’activité en 2026.

Pour aller plus loin :

L’emploi dans les effets visuels numériques en 2024 par le CNC et Audiens

Les Baromètres FICAM Long-Métrage et Fiction TV pour l’année 2025 par la FICAM

Table ronde : Industrie VFX, l’heure des grands bouleversements ?

Le même jour une table ronde “Industrie VFX : l’heure des grands bouleversements ?” animée par Hayley Miller (World VFX Day, UK) réunissait Béatrice Bauwens (MPC Paris), Simon Vanesse (ARTFX), Franck Lambertz (Rodeo FX Paris), Hyejin Kim (Dexter Studios, Corée) et Murat Axbulut (1000 Volt, Turquie) pour border les grandes tendances stratégiques qui transforment le marché des VFX. Comment repenser les modèles économiques, optimiser les workflows et réorganiser les équipes face notamment à l’essor de l’IA. La dimension internationale a également été au cœur des échanges, avec une réflexion sur la manière de s’adapter et de répondre aux exigences d’un écosystème mondialisé, où le choix des prestataires VFX pour les productions internationales est de plus en plus concurrentiel.

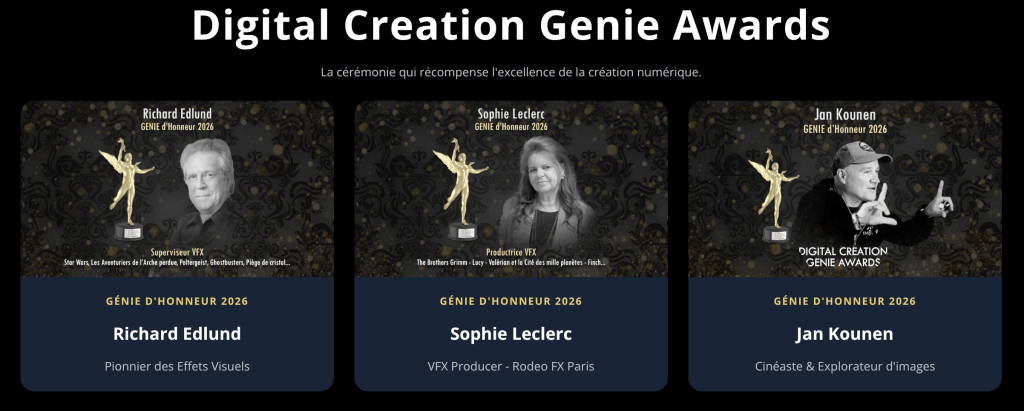

Genie Awards

Lors de la soirée de la remise des Genie Awards le 22 janvier, trois Génies d’honneur ont été décernés à Sophie Leclerc (VFX Producer, Rodeo FX Paris), Jan Kounen (Cinéaste et Explorateur d’images) et Richard Edlund (Pionnier des Effets Visuels).

Les Génies Awards ont récompensé :

- MEILLEURS EFFETS VISUELS – LONG METRAGE : The Yard VFX pour “Predator : Badlands” réalisé par Dan Trachtenberg avec Laurens Ehrmann (Superviseur VFX Senior) – Elisa Perez (Productrice VFX) – Bertrand Cabrol (Superviseur CG) – Julien Dias (Superviseur Compositing).

- MEILLEURS EFFETS VISUELS – SÉRIE : The Yard VFX pour “Stranger Things S5″ (Série – Netfix) créée par Matt & Ross Buffer avec Harry Bardak (Superviseur VFX) – Audrey Lagnous (Productrice VFX) – Eve Chauvet (Superviseuse CG) – Jeremy Pierre (Superviseur Compositing).

- MEILLEURS EFFETS VISUELS – PUBLICITÉ / CLIP : Digital District pour “Wianmax – The Moonrace” réalisé par Romain Chassaing, avec Jonathan Lagache (Superviseur VFX) – Sylvain Sarradin (Superviseur CG) – Marine Dufossez (Productrice VFX) – Maeva Bonté (Productrice VFX).

- MEILLEURS PERSONNAGES/CRÉATURES : The Yard VFX pour “Predator : Badlands” réalisé par Dan Trachtenberg, avec Juliette Grandjonc (Lead Lookdev Character) – Moïse Hammouda (Artiste Asset) – Bruno Etchepare (Superviseur Animation 3D) – Rémi Gamiette (Artiste Animation 3D).

- MEILLEUR ENVIRONNEMENT : MPC Paris pour L’inconnu de la Grande Arche” réalisé par Stéphane Demoustier avec Lise Fischer (Superviseuse VFX) – Landry De Oliveira (Superviseur CG) – Christophe Courgeau (Superviseur Environnement) – Jessica Ferry (Artiste Environnement)

- MEILLEURE SIMULATION D’EFFETS : The Yard VFX pour “Étoile” (Série – Prime Video) réalisée par Amy Sherman-Palladino et Daniel Palladino, avec Fabian Nowak (Directeur de département FX) – Hadrien Palanca (Artiste FX) – Nicolas Daguin (Artiste FX) – Louise Aubertin (Artiste FX).

- MEILLEUR FILM ÉTUDIANT– VFX/CGI : ARTFX pour “Two Kings”

Voir la liste des lauréats ici : https://www.pids-enghien.fr/genie-awards-2026/

Keynote d’ouverture : “L’année VFX 2025 : l’IA force la porte des productions”

par Marc Bourhis (Community Leader ICC & programme manager, Cap Digital) et Benoit Maujean (Délégué Adjoint Technologies, Ficam) : voir ci-dessous.

Table Ronde : “IA GÉNÉRATIVE ET NOUVEAUX WORKFLOWS VFX”

Animée par Marc Marc Bourhis (Community Leader ICC & programme manager, Cap Digital), avec

- Glenn Avezoux, Co-fondateur – CTO, Chat3D

- Julius Berg, Co-fondateur, Irrational

- Betty Jeulin, Avocat spécialisée dans la Tech, l’IA et la Propriété intellectuelle

- Quentin Auger, Directeur de l’innovation, Dada Animation et amnassdeur de Creatives Machines?

Les échanges ont porté sur comment intégrer l’IA sans dénaturer le travail créatif, composer avec des limites techniques encore fortes, et maintenir un contrôle humain dans les pipelines. Sans oublier les contraintes juridiques et environnementales.

Table Ronde : “L’OPEN SOURCE, UN LEVIER STRATÉGIQUE DE L’INNOVATION POUR RÉINVENTER LA FILIÈRE VFX FRANÇAISE ?”

Animée par Benoit Maujean (FICAM), avec

- Stéphane Donikian, Directeur de Recherche à l’Inria

- Amélie Fondevilla, Ingénieure R&D chez les Fées Spéciales

- Fabien Castan, Responsable de la R&D chez MPC / The Mill (groupe Transperfect)

- Hans-Nicholas Locher, Directeur du Développement à la CST

- Franck Rousseau, CEO et Fondateur de CG Wire

Les échanges ont porté sur comment envisager l’open source, non comme une alternative marginale, mais comme un véritable levier stratégique pour l’innovation, la souveraineté et la compétitivité des VFX français et européens.

Retour sur la Keynote d’ouverture

L’année VFX 2025 :

l’IA force la porte des productions,

par Marc BOURHIS et Benoit MAUJEAN

22 janvier 2026

1- Deux grandes familles d’IA à distinguer

On peut distinguer 2 grandes catégories d’IA, qui se différencient autant par leurs approches créatives que par leurs enjeux juridiques : l’IA Analytique et l’IA Générative.

L’IA Analytique se concentre sur l’automatisation des tâches techniques et répétitives, comme la super-résolution, la rotoscopie 2D ou 3D, le camera tracking. Elle s’intègre facilement dans les pipelines de production existants. Elle présente peu de risques juridiques (il faut quand même vérifier quand c’est possible l’origine des données d’entrainement) et ne nécessite pas d’interface graphique complexe : on donne des fichiers en entrée avec un ou deux paramètres optionnels et on obtient par ligne de commande des fichiers en sortie. Ce qui en fait un outil simple à valider et à déployer et qui est d’ailleurs abondamment utilisée par l’IA Générative. La qualité intrinsèque de ces outils est facile à vérifier en utilsant des jeux de données “vérité terrain” : par exemple des images originales en 8K pouvant être réduites en 2K avant d’être regonflées en super-résolution par des outils IA pour être comparées pixel à pixel avec les images d’origine. Enfin, la propriété intellectuelle des images de sortie ne comporte pas de risques de contrefaçon ou de parasitisme puisque à ce niveau elle est directement dérivée de celle des images en entrée.

L’IA Générative permet elle de produire rapidement des contenus créatifs variés (images, animations, sons, modèles 3D) à partir de simples descriptions textuelles ou d’images de référence. Son intégration dans les pipelines de production traditionnels reste cependant complexe, notamment en raison de la difficulté à contrôler et valider précisément les résultats obtenus. Par ailleurs, des risques importants liés à la propriété intellectuelle, tant sur les données d’entrée que sur les contenus générés, sont à prendre sérieusement en compte avant tout déploiement. Notamment dans les propositions des plateformes déployées dans le cloud où le contrôle de l’utilisation des données ingérées n’est pas toujours garanti.

2- Quelques exemples d’IA Analytique aved les bénéfices et risques associés

- Les outils de SuperRésolution permettent d’obtenir des agrandissements (x2 ou x4) généralement avec une qualité supérieure à celles des approches traditionnelles. Cependant, leurs résultats restent variables selon les modèles utilisés, avec un risque d’effets d’amélioration excessifs (par exemple non-respect de la profondeur de champ ou du flou de bougé), voire d’hallucinations visuelles.

Leur principal point faible réside dans leur inadaptation aux images professionnelles à haute dynamique ou à gamut colorimétrique étendu, notamment pour les fichiers 16/32 bits linéaires en images de synthèse, ou pour les images issues de caméras cinéma professionnelles. La plupart de ces modèles ont en effet été entraînés sur des images JPEG 8 bits non-linéaires, ce qui peut engendrer des écrêtages dans les hautes lumières et des dérives colorimétriques, des artefacts particulièrement problématiques lors de l’étalonnage de ces images agrandies. Des solutions existent, telles que le gamut mapping (ou le ré-entraînement des modèles en HDR: coûteux et plus lourd à mettre en place). La stabilité temporelle des séquences d’images reste également un point qualitatif à surveiller.

Aujourd’hui largement adoptée dans les pipelines d’IA Générative, la SuperRésolution souffre aussi d’un manque de standardisation : au-delà des solutions commerciales comme Topaz, il reste difficile de trouver un algorithme offrant des résultats cohérents et de qualité sur tous les types d’images en entrée, avec le bon dosage d’amélioration de rendu visuel ou de fidélité à l’image d’origine.

Video Upscale par Topaz Labs

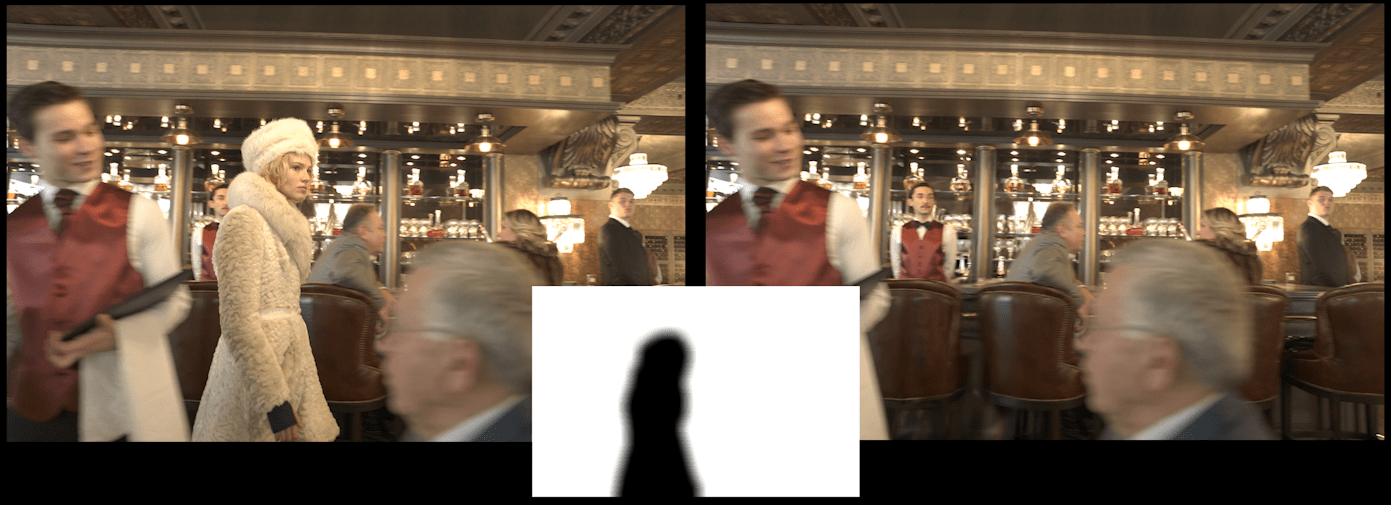

- Les outils de Rotoscopie 2D sont combinés à l’analyse sémantique des images, comme le modèle Segment Anything (SAM) de Meta, décliné en versions vidéo (SAM2) puis texte+image (SAM3).

Ce type d’algorithmes sont maintenant intégrés dans des logiciels comme Adobe ou DaVinci Resolve. Si elles ont considérablement accéléré le travail de rotoscopie 2D, ces solutions restent imparfaites face aux cas complexes tels que les flous de bougé, les faibles profondeurs de champ, les occlusions ou les entrées et sorties de champ, rendant la correction manuelle des erreurs fastidieuse. Une approche complémentaire consiste à convertir les segmentations bitmap en formes vectorielles éditables (compatibles avec le keyframing traditionnel) voire à générer directement ces formes vectorielles par apprentissage automatique, ou en combinant les deux méthodes. L’ensemble de ces solutions reste en cours de développement actif et ne propose à ce jour qu’une automatisation partielle, sans garantir une robustesse à 100% sur l’ensemble des cas de figure.

Renaud JUNGMANN signale à ce sujet la présentation par le VES Chapter à London qui analyse des outils de rotoscopie 2D avec l’IA (autour de Nuke et Boris FX)

Dans cette video, la conclusion semble que si les outils de rotoscopie et de détourage automatique restent limités à la génération de previews clients et nécessitent une reprise manuelle, les fonctions d’effacement et d’inpainting donnent, quant à elles, des résultats vraiment satisfaisants.

- Les algortihmes d’In-Painting 3D permettent de proposer des outils de “clean plate nouvelle génération” qui tirent parti de la reconstruction 3D par Gaussian Splatting (3DGS) pour générer automatiquement le contenu de remplacement dans les zones à nettoyer, en s’appuyant sur un masque de segmentation 2D. Des approches comme celles proposées par le Gaussian Splat Reveal Framework de Playcanvas ou le pipeline Meshroom Clean Plate illustrent cette démarche, encore au stade de prototype, qui permet de reconstituer de manière cohérente les zones masquées à partir de l’information 3D capturée dans la scène.

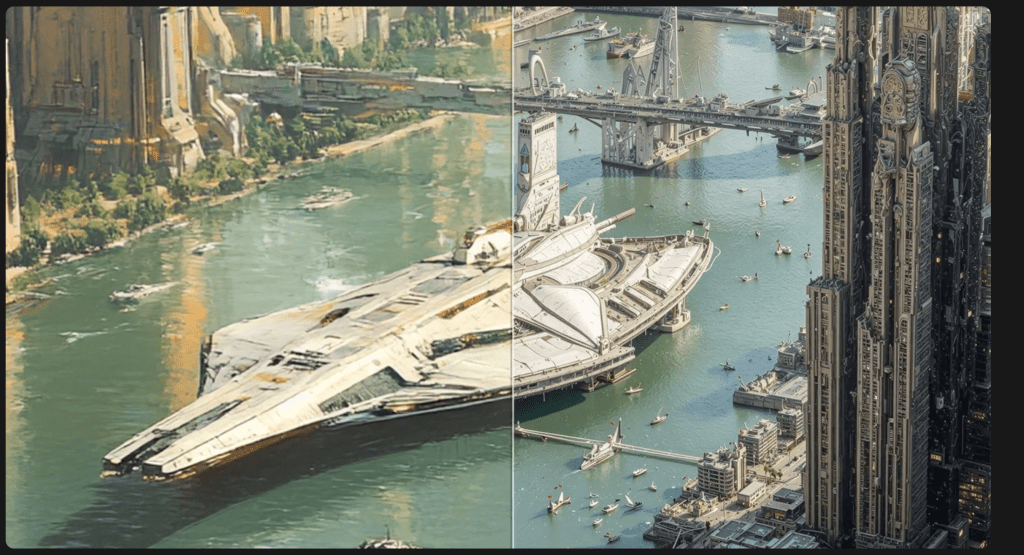

- Les outils de Reconstruction 3D reposent encore sur la photogrammétrie traditionnelle, fondée sur la vision par ordinateur, qui reste une approche incontournable en effets visuels pour générer des maillages texturés à partir d’images fixes, surout si l’asset reconstruit nécessite ensuite un traitement 3D complémentaire, comme une extension ou une transformation de décor. Les rendus inverses neuronaux représentent une nouvelle génération d’outils, d’abord avec les NeRF (Neural Radiance Fields), précis mais lents, puis le 3D Gaussian Splatting, qui offre des résultats de qualité comparable avec des temps de traitement nettement réduits. Ces deux grandes familles d’approches (traditionnelle et neuronale) coexistent aujourd’hui et se complètent selon les besoins de production, la reconstruction neuronale s’imposant progressivement comme une alternative rapide et efficace à la photogrammétrie classique, notamment pour stocker des décors où on va pouvoir placer librement une caméra virtuelle.

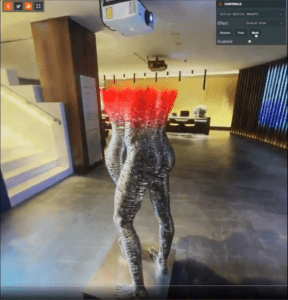

Le 3D Gaussian Splatting (3DGS) connaît un engouement considérable et s’intègre désormais dans la plupart des outils 3D, navigateurs web et smartphones, offrant un rendu photoréaliste de décors comme de personnages, et se couplant efficacement avec d’autres outils d’IA générative. La technologie est encore en pleine évolution, avec des améliorations continues de la qualité géométrique, une accélération de la phase d’auto-apprentissage, et l’émergence du rendu dynamique via le 4DGS (Gaussian Splatting sur des images animées), comme en témoignent les démos de 4DV.ai. De nouveaux paradigmes commencent déjà à pointer, comme les Nexels (combinant 2DGS et NerF) ou le Radiant Foam, qui remplace les splats par des diagrammes de Voronoï pour un rendu en ray tracing différentiable en temps réel, trois fois plus rapide et sept fois plus léger que les 2DGS classiques.

- Les outils de Camera Tracking sont indispensables pour intégrer des images de synthèse dans des prises de vue réelles. Ils reposent encore majoritairement sur des outils traditionnels à intervention manuelle, tels que 3DEqualizer, SynthEyes, MochaPro ou PFTrack. Ils commencent néanmoins à intégrer quelques briques de machine learning. Des premières solutions automatisées émergent progressivement, notamment via un pipeline dédié dans Meshroom, utilisable avec ou sans photogrammétrie, ainsi qu’au travers de modules intégrés dans Flow Studio d’Autodesk, proposé en mode SaaS ou également comme celui proposé par SlapShot.

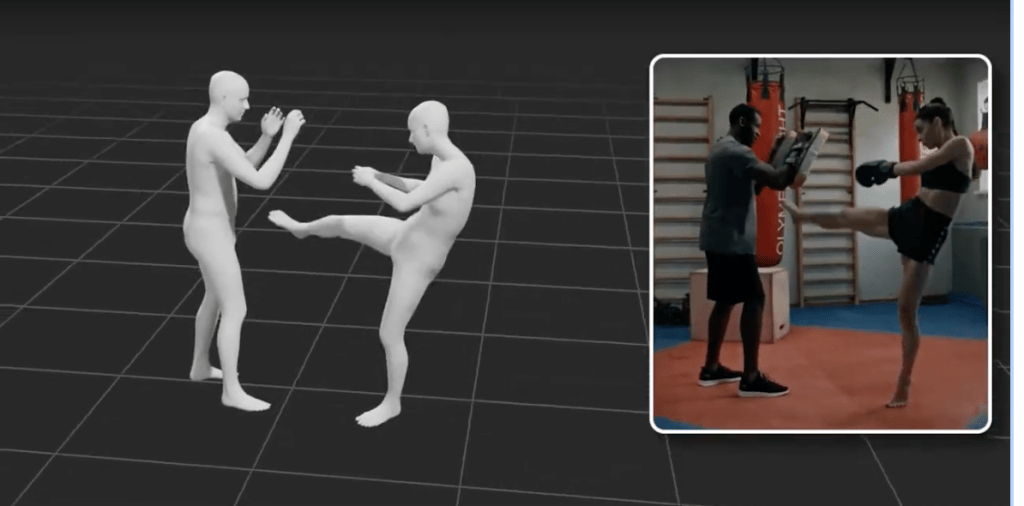

- L’IA analytique appliquée à la Rotoscopie 3D pourrait, à terme, réduire le recours aux combinaisons traditionnelles de motion capture. Des solutions comme Meshcapade, spin-off du Max Planck Institute, permettent de suivre l’animation d’un personnage 3D à partir d’une simple caméra, sans capteurs ni marqueurs. Le système fonctionne avec une caméra unique – smartphone, webcam ou caméra professionnelle, et génère un modèle 3D complet du corps et des mains. Les données produites, au format standard SMPL (modèle paramétrique 3D du corps humain basé sur le skinning et les blend shapes, appris à partir de milliers de scans 3D), sont compatibles avec les principaux outils VFX et temps réel, et peuvent inclure l’export du camera tracking.

Au moment où l’on rédige ces lignes, Meshcapade vient d’être acheté par Epic Games.

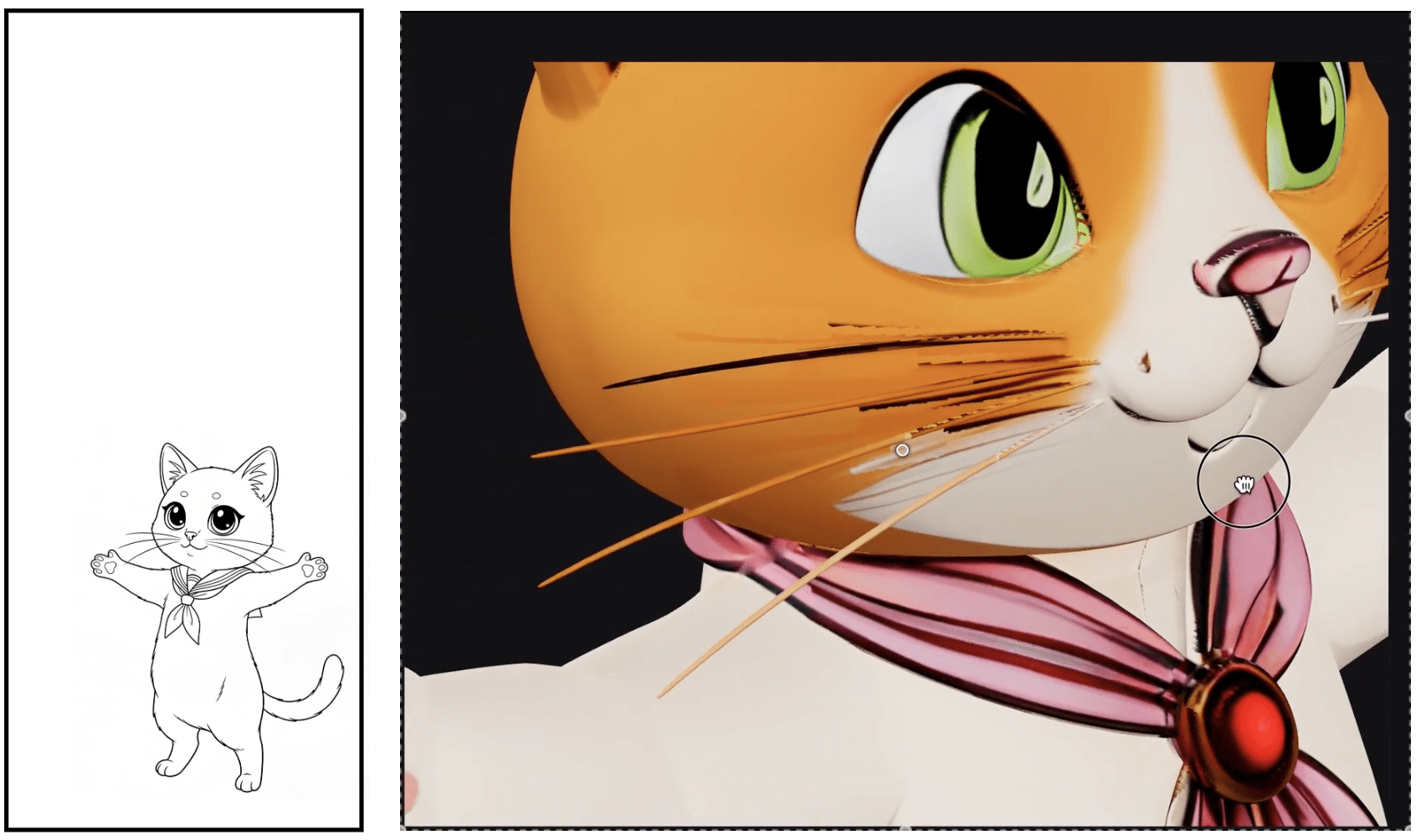

- La création d’Assets 3D à partir d’une image 2D permet désormais de générer un modèle 3D en quelques secondes à partir d’une seule vue 2D, complétée par un prompt. Parmi les solutions open source, Meta propose SAM 3D et SAM 3D Body, déjà intégrés dans des démos Houdini, tandis que Trellis2 de Microsoft offre une meilleure qualité au prix d’une plus grande exigence en ressources. Tencent se distingue avec Hunyuan3D V3, qui s’impose comme l’un des modèles les plus performants du moment. Les solutions actuelles génèrent des modèles 3D dont le maillage reste encore mal structuré, difficile à texturer et à animer. Ils peuvent servir de previz ou d’assets secondaires (ou de “calques” de référence). En France, Chat3D prend un positionnement différent : celui d’un pivot vers l’assistant créatif, conçu pour redonner la main aux artistes plutôt que de les remplacer.

A noter ici que la démarche s’apparente plus à de l’IA Générative, puisque les propriétés esthtiques des assets 3D générés peuvent rapidement s’éloigner des images 2D d’origine – et que leur création nécessite parfois un prompt pour affiner la description 3D de l’objet.

3- IA Générative : 2 éléphants dans la pièce !

Pour l’instant, les outils d’IA Générative se heurtent encore à deux freins majeurs quant à leur adoption : d’une part, les limites en termes d’interactivité et de contrôle du processus créatif, et d’autre part, les questions de propriété intellectuelle, aussi bien sur les données d’entrée que sur les contenus produits en sortie. Enfin les enjeux de frugalité et de souveraineté sont également.

- 1 er handicap : manque d’Interactivité et de Contrôlabilité

Le principal défi des outils d’IA générative réside dans la tension entre le caractère aléatoire du prompt textuel et les exigences d’une direction artistique précise : le langage naturel peine à traduire des intentions créatives fines. En effet, par essence, le prompt reste le guide directionnel par défaut dans l’espace latent des modèles génératifs.

Il en résulte un manque de contrôle sur les assets narratifs, la caméra et la lumière, sans véritable représentation dans l’espace ni dans le temps. La compréhension limitée de la modèlisation 3D dans la durée affecte également la qualité et la cohérence des résultats. Des solutions partielles existent (masques 2D, cartes de profondeur, LoRAs -modules permettant de personnaliser le style ou l’apparence d’un personnage sans réentraîner le modèle entièrement) notamment au sein des workflows que l’on peut créer dans ComfyUI, mais elles ne suffisent pas encore à répondre pleinement aux exigences d’une direction artistique précise. Tout dépend bien évidemment du niveau de qualité visé et de l’effort d’itération aléatoire que l’on est prêt à consentir.

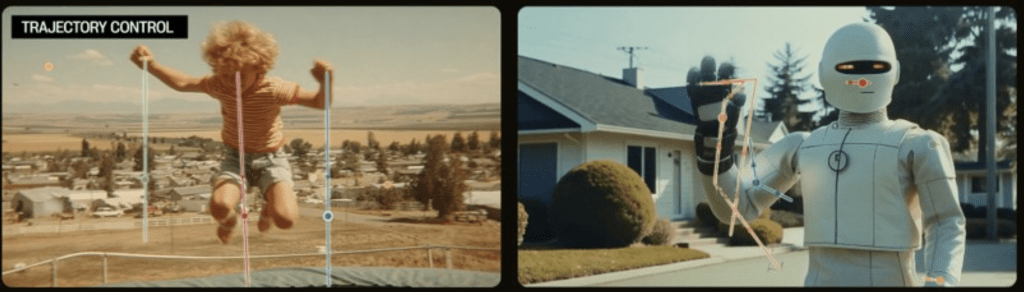

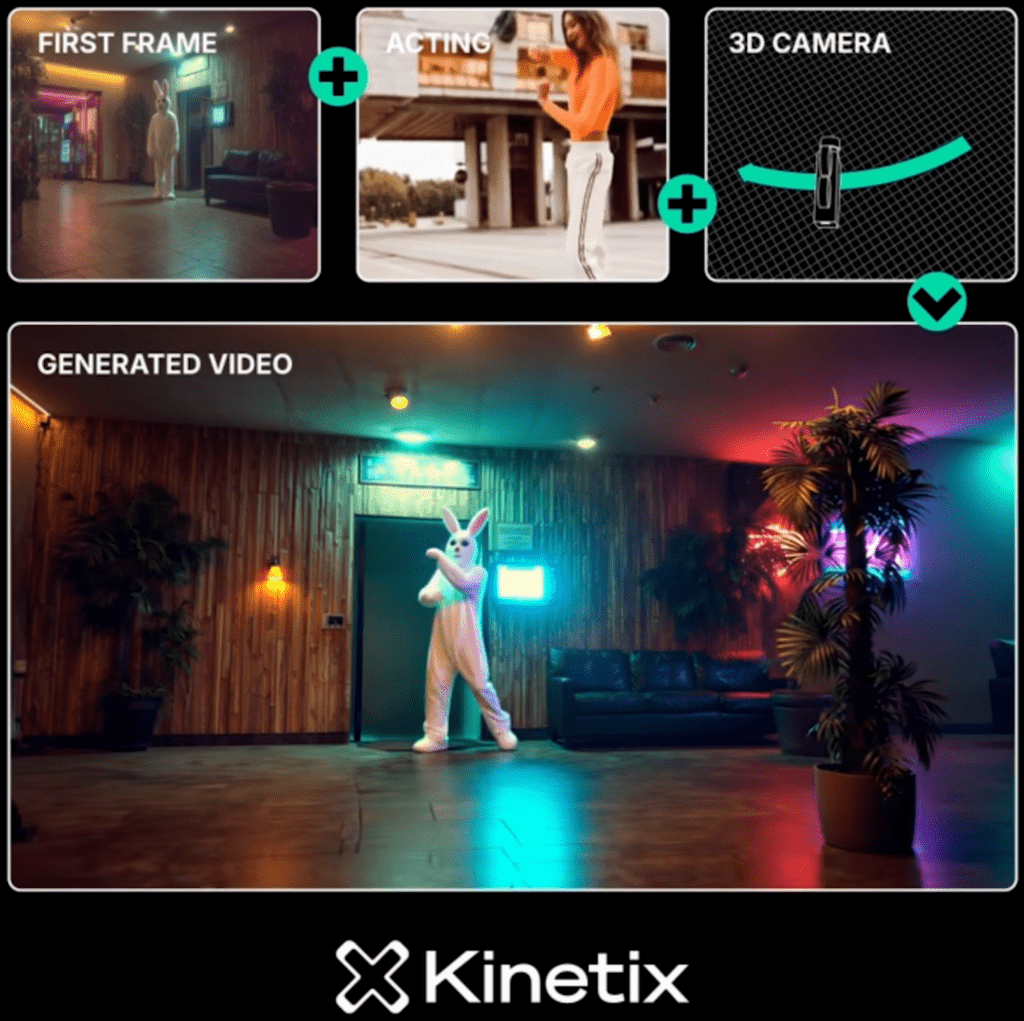

De nouvelles interfaces émergent, ouvrant des perspectives prometteuses en matière d’interactivité et de contrôlabilité. Elles restent cependant encore rudimentaires et en cours de maturation. Parmi elles, Kinetix (modèle Kamo) propose une approche video-to-video avec contrôle dans l’espace de la caméra à chaque image, ou encore Marey qui revendique un contrôle de la trajectoire des objets dans la vidéo.

Les autres limites techniques des outils d’IA générative (résolution des images de sortie et durée des plans limitées par la mémoire GPU, gestion des espaces colorimétriques contraintes par la faible qaulité des images d’entrainement, consistance et transitions inter-plans liés au caractère probaliliste de l’approche) tendent progressivement à être surmontées. Notamment grâce à des avancées comme la super résolution, les keyframes d’entrée et de sortie de plans, ou les premiers modèles HDR tels que Ray3 de Luma Labs.

Enfin, une nouvelle approche émerge, consistant à envisager l’IA générative non plus comme un outil isolé, mais comme un générateur de séquences à intégrer dans des workflows hybrides. Ces workflows combinent séquences IA et tournages live, ou associent outils d’IA Générative et outils traditionnels de compositing, de modélisation et d’animation 3D. L’IA Générative peut alors s’inscrire ainsi dans un écosystème plus large, en dialogue avec les outils d’IA Analytique et les pipelines de production existants.

- 2eme handicap : Gestion de la Propriété Intellectuelle

La propriété intellectuelle soulève des problèmes juridiques aux deux extrémités de la chaîne de production : en amont, l’entraînement des modèles d’IA Générative repose souvent sur des œuvres protégées utilisées sans autorisation de leurs ayants droit, soulevant un conflit entre le principe du “Fair Use” et le droit d’auteur. En aval, la question de l’appropriation des contenus générés reste entière : d’une part l’originalité d’une création purement IA est contestable, et les outils SaaS dans le cloud exposent les données à des risques de fuite via leur effet “boîte noire”. Face à ces enjeux, il devient indispensable de conserver une trace précise des processus de fabrication, afin de démontrer l’intervention humaine et de prévenir toute contestation de contrefaçon ou de parasitisme. La gestion de la propriété intellectuelle s’impose ainsi comme un défi majeur pour quiconque intègre l’IA Générative dans un pipeline de création professionnel.

Pour éviter les retraits massifs de contenus de la part des ayants droit, les grandes plateformes américaines ont engagé en 2025 des négociations de gré à gré avec les détenteurs de catalogues cinématographiques, audiovisuels, musicaux et littéraires. Ces accords prennent des formes variées, allant du licensing de données d’entraînement (comme entre Lightricks et Shutterstock) au partenariat de production, à l’image du deal conclu entre Runway et Lionsgate. Certains accords atteignent des montants considérables, tels que le character licensing upfront d’un milliard de dollars signé entre Disney et OpenAI, ou les 1,5 milliard de dollars négociés par Anthropic avec des fonds d’indemnisation d’auteurs (soit environ 3 000 dollars par livre). Ces négociations dessinent un nouveau cadre économique pour l’IA générative, où la valorisation des œuvres existantes devient un enjeu central entre acteurs technologiques et industries créatives.

En France, deux rapports du Conseil supérieur de la propriété littéraire et artistique (CSPLA) publiés en 2025 posent un cadre juridique clair : le droit d’auteur européen s’applique aux IA génératives non-européennes utilisées dans l’UE, et l’entraînement commercial sur des œuvres protégées sans autorisation constitue une violation de ce droit. Pourtant, mettre en œuvre une compensation financière reste difficile, faute de conditions nécessaires : il manque à la fois une identification précise des œuvres utilisées pour l’entraînement et plus globalement une traçabilité des données de l’entrée à la sortie des outils d’IA.

Plusieurs modèles de solution émergent et peuvent se combiner :

- les accords de gré à gré à l’américaine, qui tendent à favoriser les gros ayants droit,

- les organismes de gestion collective à l’européenne, plus équitables

- les micropaiements automatisés dans des espaces de données de confiance, approche innovante encore en développement.

Autres enjeux fondamentaux : souveraineté et frugalité

La question de la transparence sur les données d’entraînement s’inscrit plus largement dans les revendications “open source” des outils d’IA, lesquelles relèvent souvent davantage d’une stratégie de communication que d’une réelle ouverture, avec une tendance marquée à l’open washing.

Un framework IA (pour éviter l’ambiguité du mot “modèle”) véritablement open source repose sur trois familles de composants essentiels : les données d’entraînement, le logiciel d’entraînement et le modèle entraîné, dont chacun doit être couvert par une licence afin d’en garantir réellement l’usage, l’étude, la modification et le partage, pour faire référence aux principes fondamentaux de l’approche open source.

L’Open Source AI Definition (par l’OSI, l’organisation dévouée à la promotion des logiciels open source, notamment à travers la défintion de leurs licences) encadre ces 3 composants en proposant des licences spécifiques : open source pour le code, CC-BY-4.0 ou CDLA-Permissive-2.0 pour les données, et CC-BY-4.0 pour la documentation. Il est important de noter que l’OSI exige le partage des informations relatives aux données, mais pas nécessairement des données elles-mêmes. Le Model Openness Framework de la Linux Foundation propose quant à lui une classification hiérarchique en trois niveaux, exigeant a minima la transparence sur l’architecture du modèle et la caractérisation des données.

En réalité, les modèles dits “open” se limitent le plus souvent à la mise à disposition du seul code du modèle entraîné, assorti de licences spécifiques, comprenant par exemple des restrictions d’usage éthiques ou commerciales, voire avec une limitation d’usage à la recherche – cette dernière restriction limitant de fait leur intégration dans des logiciels traditionnellement open source, dont l’usage commercial n’est évidemment pas interdit !

L’atout majeur des modèles “ouverts” tient à leur capacité à être déployés directement sur site, assurant ainsi la confidentialité et l’intégrité des données de production, là où les modèles fermés en mode SaaS impliquent un transit et un traitement plus opaque des données dans le cloud.

Les données d’entraînement sont issues de plusieurs approches qui peuvent être combinées : scraping du web (YouTube, Vimeo…) au prix d’une qualité médiocre et de violations du droit d’auteur, datasets publics (WebVid-10M, LAION-5B…), ou encore données synthétiques. Le risque d’autophagie et d’effondrement des modèles est réel si l’on n’élargit pas le périmètre des données d’entrainement avec un cadre légal de confiance entre créateurs de contenus et fournisseurs de technologie: la qualité et la fiabilité des données d’entraînement conditionnent directement celles des modèles d’IA, et donc des contenus générés.

La régulation et la transparence de ces données devrait donc constituer un cercle vertueux avec des enjeux tout à la fois éthique, juridique et technologique, et qui rejoignent plus largement les impératifs de souveraineté numérique.

Après une phase de sidération face aux performances des IA Génératives, une prise de conscience collective émerge quant à leur impact environnemental, amplifié par l’effet rebond : la multiplication des itérations et la banalisation d’un usage toujours plus intensif entretiennent l’illusion, alimentée notamment par les fabricants de processeurs, que les capacités de calcul GPU sont quasi infinies et perpétuellement renouvelables. Pourtant, la pression des studios à respecter les délais et à maîtriser les coûts n’est pas contradictoire avec une démarche de sobriété énergétique : optimiser les ressources de calcul et privilégier des modèles mieux calibrés aux besoins réels des productions va précisément dans le sens d’une plus grande efficacité économique et opérationnelle.

La sobriété énergétique ne doit pas être confondue avec une limitation des usages, mais invite plutôt à challenger les modèles généralistes fermés au profit de modèles plus petits, mieux adaptés aux besoins réels des productions. Les modèles open source et réutilisables peuvent également permettre de mutualiser les ressources d’entraînement et de garantir une plus grande transparence et donc une meilleure maitrise sur les algorithmes et les données. L’opportunité est ainsi de transformer la frugalité en véritable moteur d’innovation, au service de la création et de la recherche.

Pour aller plus loin :

Publié par Creative Seeds en février 2026, en partenariat avec le collectif “Creative Machines” et avec le soutien du CNC et de France 2030, la video “Génération IA” dresse un état des lieux assez complet de l’IA Générative dans l’industrie audiovisuelle, en analysant ses implications concrètes pour la création ainsi que les limites créatives actuelles et futures. Il souligne notamment que les compétences artistiques demeurent essentielles pour guider et contrôler ces outils, sans pour autant occulter les impacts éthiques, légaux et écologiques qui en découlent.

2- Présentation du studio Neo.B4

Genèse du projet

par Jérémie TONDOWSKI (NEOSET)

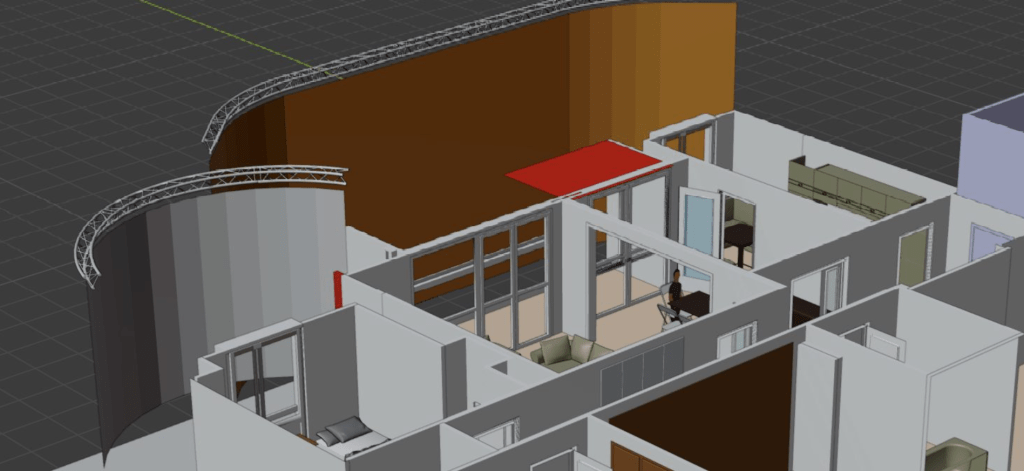

Le Neo.B4 est un plateau de tournage proposé par NEOSET, dédié à la production d’ICVFX (pour In Camera VFX), soit la réalisation d’effets visuels directement en plateau via des écrans LED, à distinguer de la notion plus large de “production virtuelle” qui englobe fond vert, préviz et autres techniques. Conçu pendant le confinement de 2020, dans le sillage du succès de The Mandalorian (la saison 1 produite par Disney en 2019 dont les décors fantastiques ont été réalisés en grande partie en temps réel avec Unreal Engine, projetés sur des murs de LED), le projet s’est construit autour d’un cas d’usage prioritaire : le “rouling” (trajets en voiture tournés en plateau, où le décor défile autour du véhicule). Faute de financement initial, ce qui s’avérera une chance, l’équipe a été contrainte de développer un modèle économique viable et cohérent plutôt que de s’appuyer sur des ressources externes. Le projet “Loin du Periph” avec Netflix a permis de financer une phase de R&D : mise en place d’un workflow dédiés à la fiction avec captation et traitement de pelures à 360°, plus le développement de serveurs media maison.

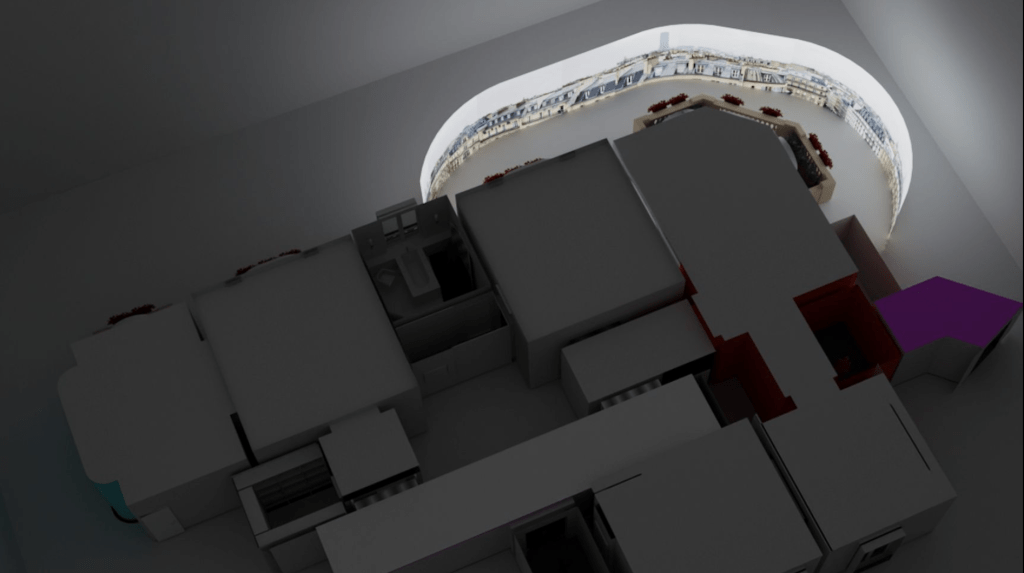

Fort de cette expérience itérative, NEOSET a franchi une nouvelle étape avec l’installation 5 ans plus tard d’un plateau LED aux studios de Bry-sur-Marne. Neo7 dispose désormais d’un plateau de 300 m2 équipé de 120 m² d’écrans LED concrétisant un modèle économique pensé dès 2020 et rendu possible grâce à l’Aide aux Moyens Techniques du CNC, impliqué depuis le début. Ce plateau s’inscrit dans un contexte favorable : un marché plus mature, une expertise désormais reconnue, et les studios de Bry en pleine expansion qui, en doublant leur surface pour atteindre 70 000 m² de bâtiments, ambitionne de devenir le troisième plus grand studio d’Europe.

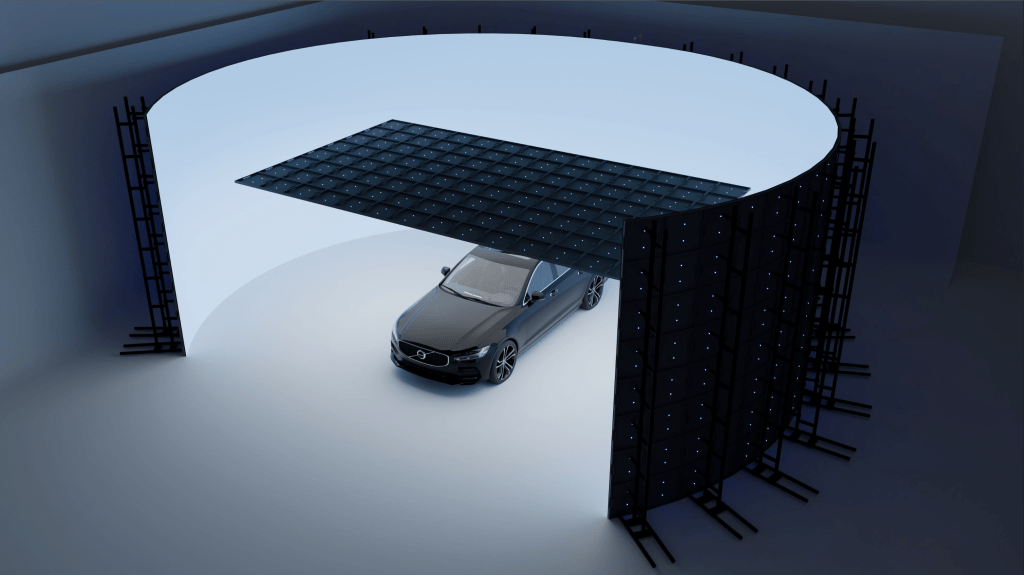

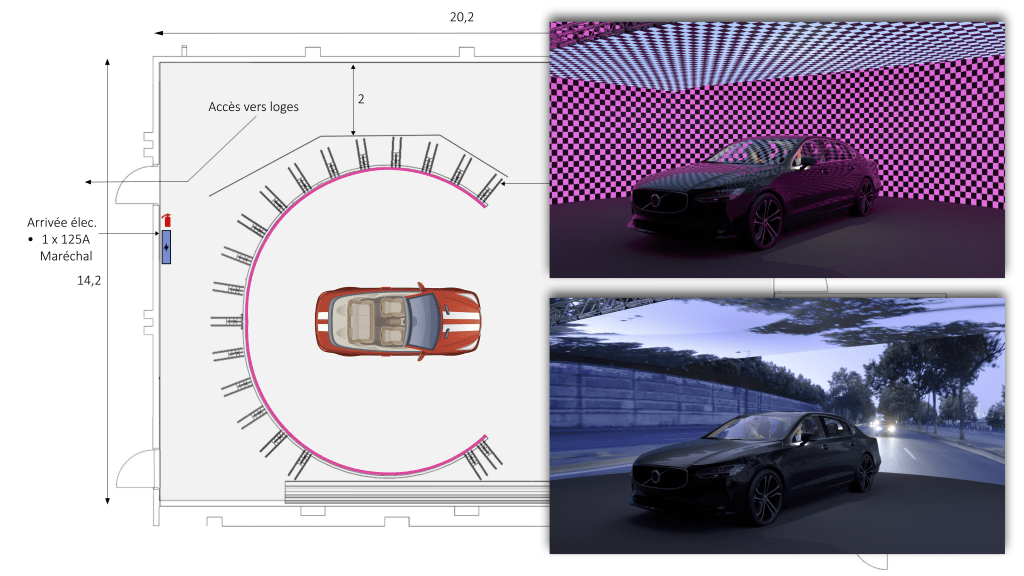

Un outil pensé pour la voiture

Conçu autour d’un cylindre LED de 4 m de haut et 10 m de diamètre (120 m²), le plateau est optimisé pour les séquences véhicules. Sans déplacer la voiture (posée sur roulette), il est possible de couvrir une grande variété de plans (face, trois quarts, latéraux, arrière) avec des reflets naturels et cohérents sur le pare-brise, les vitres et les rétroviseurs. La qualité des écrans et la maîtrise des reflets (notamment via un grand plafond LED) sont au cœur du dispositif et ont pu être calibrés par une conception avec prévisualisation en 3D.

Le plateau a déjà servi à 17-18 projets et le premier film à sortir sera celui réalisé par Olivier Nakache et Éric Toledano qui sort en avril 2025.

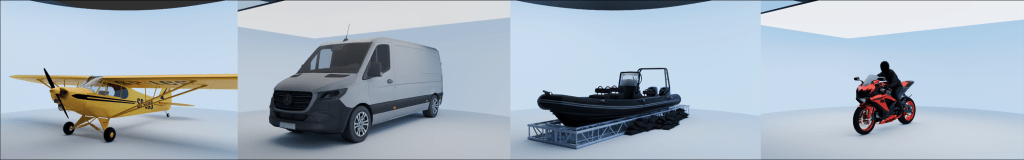

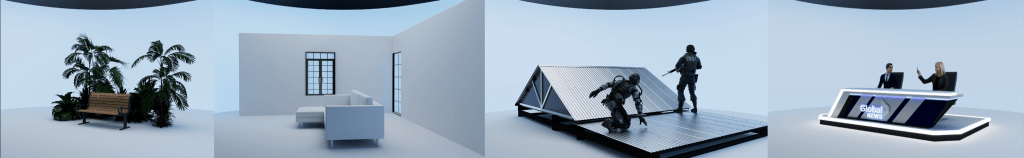

Des usages au-delà de la voiture

Le plateau accueille aussi des motos (avec ajout d’écrans frontaux pour fermer l’espace à 360°), des fourgonnettes, des cockpits d’avion, … Il permet également de tourner des séquences sur des toits ou dans de petits décors reconstitués : chambre d’hôtel, balcon, plateau TV…. On peut ainsi faire exister des décors légers qui auraient pu être supprimés en production classique, apportant de la richesse narrative à moindre coût.

Complémentarité avec les VFX

Les retours de superviseurs VFX illustre les apports concrets de l’ICVFX en regard du fond d’incrustation (vert ou bleu) traditionnel : le chef-opérateur, voyant un prototype de son image finale en temps réel, éclaire et compose le cadre différemment, avec plus d’intention artistique. Les raccords regards des comédiens sont nettement plus justes, car tous les intervenants (scripte, réalisateur, équipe) partagent la même référence visuelle, notamment lorsqu’on fait tourner le décor dans les champs-contrechamps. L’ICVFX et les VFX traditionnels apparaissent ainsi comme complémentaires, notamment sur des projets hybrides intégrant la retouche finale des décors en post-production.

Même si on n’est pas à l’échelle des grands moyens des super productions américaines – avec des univers d’images de synthèse projetées sur des énormes plateaux de LED (murs cyclos, plafond, sol), on arrive quand même à tourner en étant immergé dans l’univers des décors, quitte à prévoir quelques amorces de fonds d’incrustation là où la rotoscopie sur le décor direct sera plus délicate. En faisant ça, on a un peu le meilleur des 2 mondes : tournage avec décor et post-production VFX.

Banque de données de décors

Depuis plusieurs années, NEOSET constitue une banque de données de pelures 360 (soutenue par le CNC via l’Aide aux Moyens Techniques) qui s’avère aujourd’hui essentielle à l’activité. Sur le seul deuxième semestre 2025, environ la moitié des projets ont été réalisés uniquement à partir de cette banque, sans tournage de pelure spécifique. En effet, dès lors que les séquences impliquent un simple déplacement en décor générique (campagne, ville) sans contrainte d’exactitude géographique ni d’interaction avec l’environnement extérieur, les ressources existantes suffisent. Une banque de découvertes vient compléter ce fonds et trouve également son utilité de façon ponctuelle.

La gestion des retakes

Ce plateau s’avère particulièrement pertinent pour les retakes. Un cas concret l’illustre bien : suite à l’indisponibilité prolongée d’un comédien, une production a dû terminer son tournage avec une doublure pour tous les plans larges et les champs directs. Les contrechamps sur le comédien absent, eux, ont été remplacés par des pelures tournées selon un cahier des charges précis. Six mois plus tard – au retour du comédien, ces contrechamps pourront enfin être réalisés sur le plateau. L’exercice présente quelques défis, notamment sur la lumière, mais reste tout à fait maîtrisable. Anecdotique en volume, ce type d’usage représente néanmoins une vraie économie de production, une problématique déjà très présente à l’époque du Covid.

Cette approche permet aussi de sauver des plans au montage. Sur un projet récent, l’équipe manquait de plans de déambulation en rue. En deux heures, en fin de journée, trois décors différents ont été reconstitués grâce à des pelures tournées par le chef-op et le réalisateur. Le résultat, avec un travail sur le flou d’arrière-plan pour recréer de la profondeur, s’intègre naturellement et surpasse largement ce qu’aurait donné un fond vert mal composité. Une approche finalement pas si éloignée de ce que Stanley Kubrick faisait déjà sur Eyes Wide Shut, avec des retakes sur tapis roulant devant une pelure film de décor projetée en arrière-plan.

Neoset a déjà mis en œuvre ce type de cas d’usage de Walk & Talk en conditions réelles de production, notamment pour pallier l’absence de plans de déambulation en extérieur, à partir de pleures tournées par l’équipe de production.

Technique du ghost frame

NEOSET a pu faire des tests sur la technique du “ghost frame” (image fantôme), sans l’avoir directement utilisée en production.

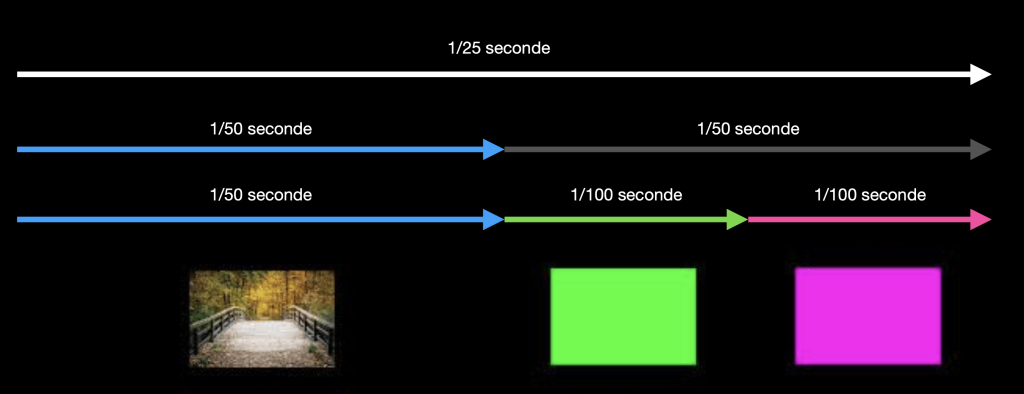

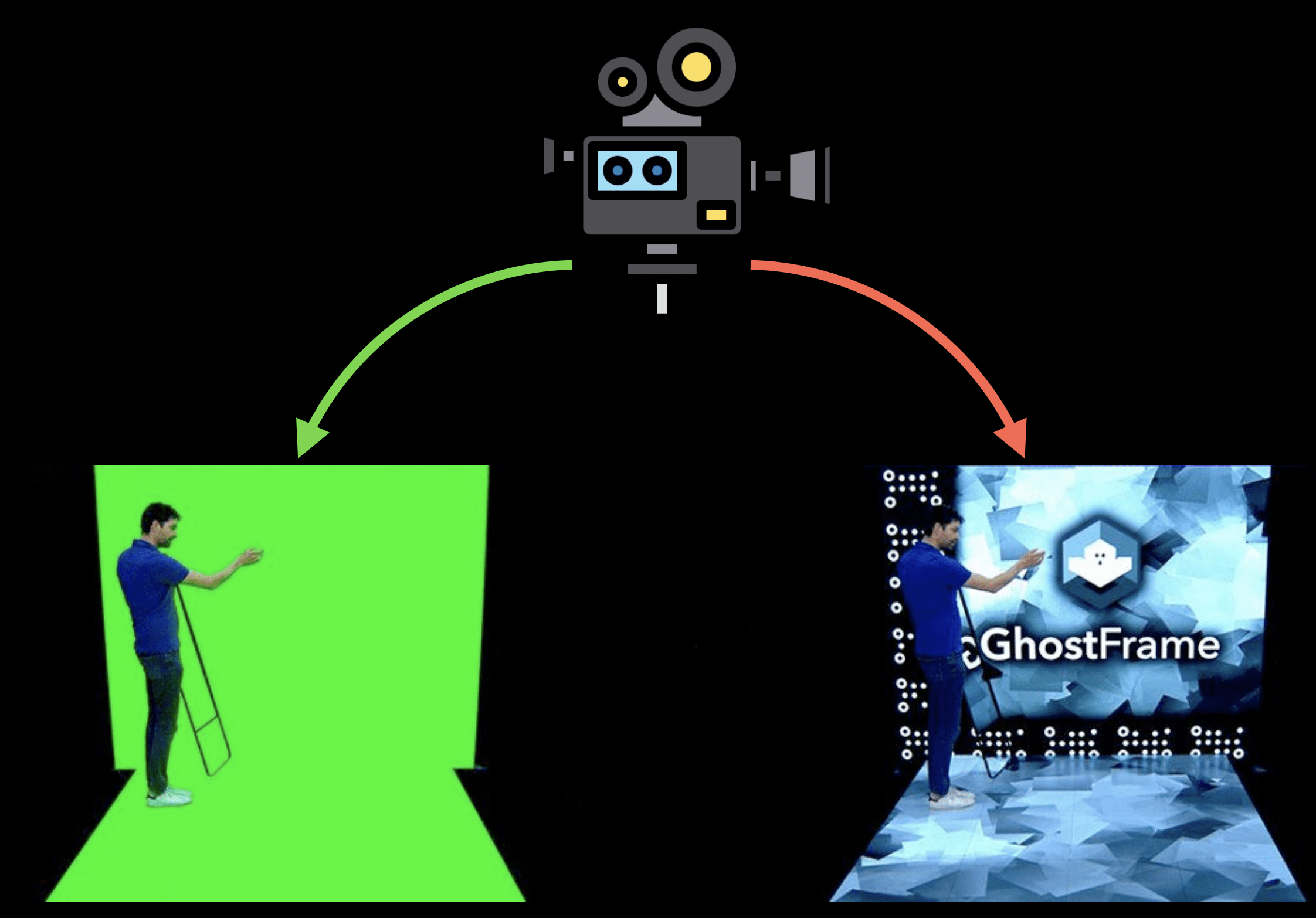

Le principe du ghost frame consiste à exploiter le temps de fermeture de l’obturateur de la caméra pour afficher une image supplémentaire par rapport au décor projeté : alternativement une image verte et une image magenta. L’image magenta joue un rôle de compensation visuelle : par persistance rétinienne, le vert et le magenta s’annulent, évitant aux équipes sur le plateau un papillotement désagréable. Ce dispositif impose un obturateur réglé au 100e de seconde, pour un enregistrement à 50 images/seconde, et un genlock parfait entre la caméra et l’affichage du décor.

L’idée est de capturer alternativement le sujet sur fond vert (pour générer un cache en post-production) et le sujet sur décor final. Mais cette approche hérite des problématiques classiques du fond vert (éclairage contraint, contamination du vert sur le personnage et le décor) et introduit un décalage temporel d’un 50e de seconde entre les deux flux, source de problèmes dès qu’il y a du mouvement (personnage ou caméra). La caméra RED V-Raptor offre une solution partielle en générant directement deux flux d’enregistrement distincts. Le workflow n’en reste pas moins alourdi : gestion des rushs au labo, transmission aux équipes VFX, et risques de perte d’information si la chaîne de traitement des données et métadonnées n’est pas rigoureusement coordonnée.

Les avancées récentes des outils de segmentation par IA facilitent aujourd’hui la rotoscopie directement sur fond de décor, sans recourir au fond vert, ce qui relègue la double passe au rang d’option ponctuelle.

Ce workflow du ghost frame est en réalité éprouvé de longue date : il est utilisé depuis des années dans les retransmissions sportives internationales, pour les publicités LED en bordure de terrain, gérant des annonces locales qui s’adaptent au pays diffuseur. Le scintillement vert est compensé par du magenta pour ne pas incommoder le public. Une technique déjà bien maitrisée dans ce secteur, avant son adoption dans le cinéma.

L’ICVFX / Production Virtuelle : un pont entre le plateau et la post-production

Un constat paradoxal s’est imposé dès les débuts : ce sont souvent les profils les plus réfractaires aux VFX, les “naturalistes”, ceux qui veulent sentir le mouvement d’une vraie voiture, tourner dans de vrais décors, qui adhèrent le plus facilement à l’ICVFX. À l’inverse, ceux qui ont l’habitude du fond vert ou du fond bleu se retrouvent parfois déstabilisés : cette approche les oblige à prendre des décisions, sinon en amont, du moins le jour même du tournage, une contrainte à laquelle ils sont moins habitués.

Cette question de la maîtrise artistique soulève un sujet plus large : qui est vraiment responsable de l’image finale quand une grande partie du cadre est construite en post-production ? En théorie, le chef-opérateur signe l’intégralité de l’image (VFX compris) et le chef décorateur assume aussi les extensions de décor. Mais en pratique, cela impliquerait leur présence en post-production, dans des environnements qui ne leur sont pas familiers. Le plateau et la salle de compositing avec les VFX restent deux mondes parfois encore largement étanches. C’est précisément avec l’usage des plateaux de production virtuelle que la pédagogie et la promotion croisée de nos métiers ont un rôle à jouer pour réduire ce fossé.

L’utilisation en mode “découvertes”

La LED trouve une deuxième grande application dans la création de découvertes en studio, ces fenêtres fictives donnant sur un extérieur, qu’il s’agisse d’un appartement, d’une chambre ou d’un salon. Les décors affichés sont principalement en 2D, avec une vue lointaine, et peuvent être retouchés selon les besoins : modification des façades, adaptation à une époque précise, etc.

L’un des atouts majeurs de la LED dans cet usage est sa flexibilité formelle : elle peut prendre à peu près n’importe quelle forme et s’intégrer dans des configurations variées, comme des fenêtres d’angle dans une grande chambre d’hôtel. Elle permet aussi de travailler la lumière à différents heures et, grâce au tracking, donner une légère profondeur à une image 2D, suffisante pour casser l’effet de “bâche imprimée” à distance fixe et redonner une sensation de relief.

Concernant le pilotage du tracking du décor, une approche simple à la main (avec un joystick) s’avère souvent suffisante pour les découvertes, évitant le déploiement de systèmes complexes de tracking en temps réel. Ces derniers présentent leurs propres contraintes : lourdeur technique d’installation, autorisations à négocier avec le chef décorateur ou le chef opérateur, et surtout des risques de sautes ou de bugs dès que l’environnement devient complexe (miroirs, vitres, changement de pièce).

Béatrice BAUWENS élargit le débat en fin de session et ajoute que cette réflexion pointe un enjeu central : faire entrer les outils numériques sur le plateau, non pas en opposition au tournage traditionnel, mais en complément. L’idée n’est pas de substituer le outils numériques au live action, mais de mieux exploiter ce qui se passe sur le tournage pour faciliter l’intégration VFX en aval.

Un chantier récurrent revient : la récupération des données de tournage dans toute leur complexité. En l’état, les équipes VFX se retrouvent le plus souvent avec l’image capturée des rushes avec quelques métadonnées, si elles ne sont pas perdues en route (après des étapes de conversion par exemple). Car les VFX s’inscrivent dans une chaîne avec 3 acteurs complémentaires : le laboratoire qui livre les images originales, le montage qui ne travaille qu’en mode proxys (avec des images de taille réduite), et le studio qui reçoit les fichiers finalisés. Dans ce flux, des données pourtant précieuses (hauteur et positionnement de la caméra, changements d’axe, métriques du plateau) disparaissent ou ne sont pas toujours enregistrées. Or ce sont exactement ces données qui permettent de compléter les autres données pour reconstruire un plateau en 3D, dans lequel une caméra virtuelle vient filmer un élément de synthèse destiné à être composité avec les éléments du live action.

Certaines de ces données varient temporellement et nécessiteraient un enregistrement continu ; d’autres, comme la photogrammétrie, sont plus statiques. La piste d’un enregistreur dédié de position de caméra (léger, autonome, dissocié de la caméra elle-même, mais synchronisé avec le record) apparaît comme une solution prometteuse. Des expériences ont déjà eu lieu dans ce sens, notamment sur les séries Vortex et sur le long métrage Vermine, avec des systèmes de tracking type STYPE, non sans quelques dérives temporelles.

Les outils de Zeiss ont également été évoqués : par exemple, la capacité à mesurer les distances en fait naturellement un candidat pour alimenter les assistants caméra, et donc potentiellement un enregistreur permanent de données métriques. Reste la question du format et du moyen de stockage de ces données. D’autres outils Zeiss permettent par ailleurs de caractériser la distorsion optique et le vignettage des objectifs, deux paramètres clés pour aligner l’image captée sur le plateau avec celle produite par une caméra 3D, caméra idéale sans distorsion. L’implémentation de ces outils reste cependant coûteuse et pas toujours adaptée aux contraintes d’un tournage.

Au-delà des questions techniques, la difficulté est aussi de l’ordre de l’humain et des relations hiérarchiques sur un plateau, où, pendant un tournage, les superviseurs VFX sont loin d’être en position de force. Demander au chef opérateur ou au premier assistant de modifier leurs pratiques pour intégrer des accessoires permettant d’enregistrer des métadonnées supplémentaires relève parfois du parcours du combattant. D’où l’intérêt d’un enregistreur autonome, discret, qui ne dépendrait pas de la chaîne caméra et pourrait fonctionner en parallèle, sans alourdir le plateau ni bousculer les habitudes (une piste qui pourrait par exemple être soumise à la CST).

La réunion se termine à 19:00.